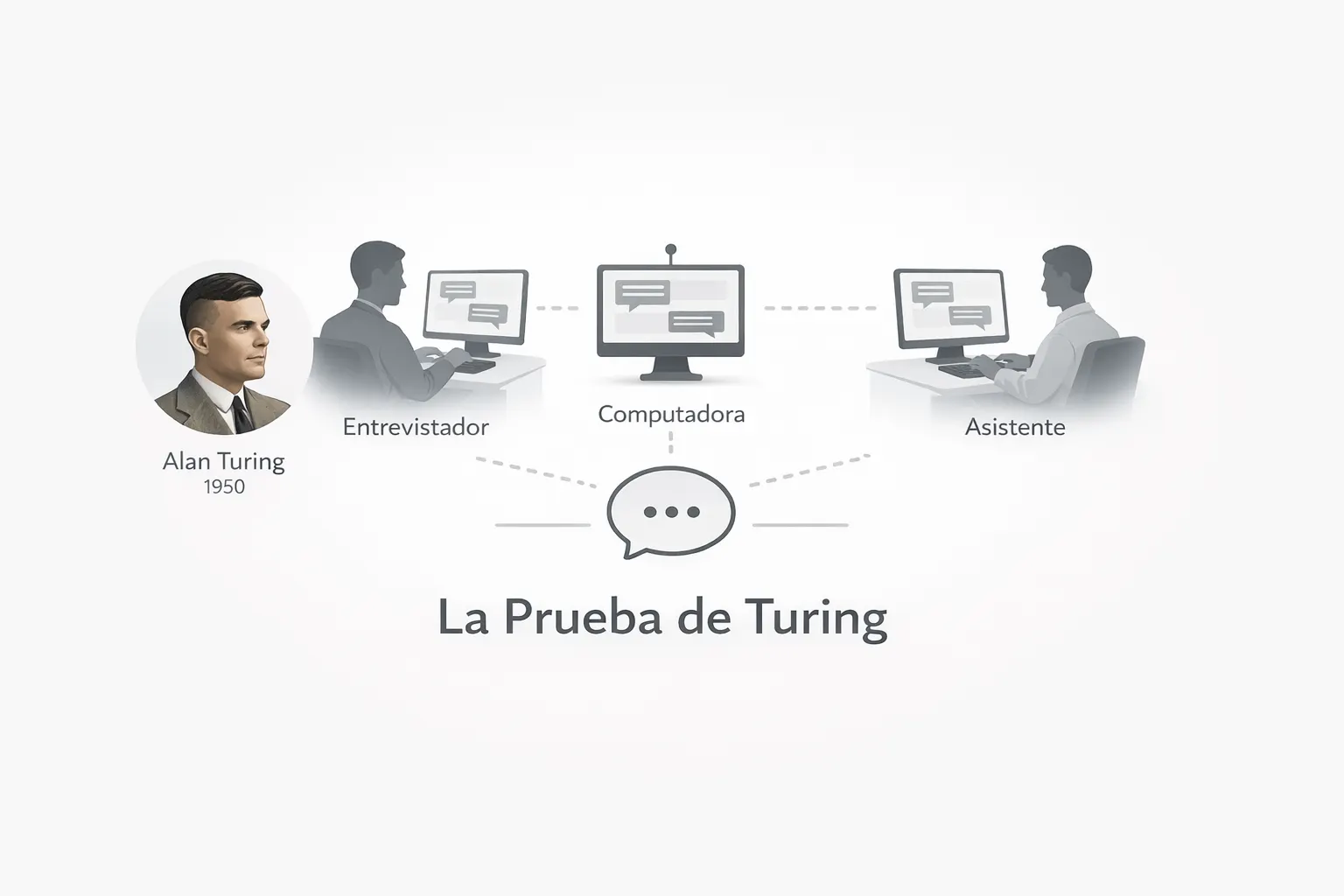

Universidad Nacional Autónoma de México ¿Pueden las máquinas pensar, entender, sentir y ser conscientes? Esta pregunta la planteó por primera vez, en un entorno académico y científico, el matemático inglés Alan Turing, en el artículo Maquinaria Computacional e Inteligencia, publicado en 1950. En éste se incluye un experimento mental al que Turing llamó el juego de imitación, que después se popularizó como la prueba de Turing. Participan tres jugadores: una computadora y dos seres humanos (el entrevistador y el asistente). Los tres están en cuartos separados, pero se pueden comunicar por un teletipo para evitar reconocerse por la voz o visualmente. El propósito del entrevistador es identificar quién es la computadora y quién es el asistente, a través de una conversación sin restricciones en lenguaje natural. El objetivo de la computadora es hacerle creer al entrevistador que “ella” es el ser humano, para lo cual tiene que mentir, y gana cuando lo logra. El rol del asistente es auxiliar al entrevistador, respondiendo a sus preguntas con la verdad. Turing propuso que, si la computadora pasa la prueba, tendríamos que aceptar que ésta entiende, es consciente y tiene sentimientos.

Turing puso la vara alta y propuso un segundo juego, al que llama viva voce, el cual consiste en conversar espontáneamente para saber si nuestro interlocutor realmente entiende o sólo repite como perico, como cuando queremos saber si un niño entendió el texto de la tarea o apenas se lo sabe de memoria. Se trata de poner en aprietos al adversario en un diálogo de preguntas y respuestas. Pierde el que se queda trabado, o quien ya no puede presentar contraargumentos.

Los programas que conversan en lenguaje natural siempre han sido muy populares. Un ejemplo muy temprano fue Eliza, desarrollado por J. Weizenbaum en el MIT en 1965, que simulaba ser un terapista Rogeriano. En ocasiones, este programa era capaz de mantener una conversación convincente y coherente con el usuario. Una famosa anécdota cuenta que un día Weizenbaum encontró a su secretaria llorando porque Eliza “sí la comprendía”. Un ejemplo reciente en nuestro entorno es el lenguaje conversacional del robot Golem-III. Otro programa reciente y poderoso es ChatGPT, creado por OpenAI, que juega sorprendentemente bien a la viva voce, pero ocasionalmente incluye falsedades en sus respuestas ante preguntas factuales.

La prueba de Turing aparece representada, con matices, en la ciencia ficción, por ejemplo, en los cuentos Usher II y Los Largos Años, incluidos en Crónicas Marcianas de Ray Bradbury, publicado, coincidentemente, en 1950. El primero relata una historia de terror en la que los miembros de un comité de defensa de la moral (quienes detestan la libertad y la creatividad) se confrontan con sus réplicas robóticas exactas, quienes finalmente los matan. La segunda es una historia muy hermosa sobre los robots de compañía, en la que muy

http:golem.iimas.unam.mx/inference-in-service-robots

pronto se sabe que son robots y, sin embargo, no dejan de ser objeto de empatía. En ambas historias los robots se presentan con forma humana y son aparentemente indistinguibles de nosotros.

Un análisis más profundo aparece en la novela ¿Sueñan los androides con ovejas eléctricas? de Philip K. Rick, también de 1968, en la que se basa la película Blade Runner (1982). En este mundo se fabrican androides indistinguibles de los seres humanos, para servir como esclavos, lo cual desata una rebelión y éstos se tornan agresivos. Se diseña entonces una prueba para detectarlos, pero la frontera entre lo humano y lo maquinal es muy difusa. Hay varios giros sorprendentes en esta historia, en la que los androides se creen humanos y los humanos llegan a dudar de sí mismos. Esta novela nos invita a preguntarnos, a final de cuentas, ¿qué significa ser humano?

La prueba de Turing fue refutada convincentemente por el filósofo John Searle en 1980 con otro experimento mental llamado el argumento del cuarto chino. En éste hay una habitación, con dos ventanas; adentro está un ser humano que no sabe chino, pero que cuenta con una tabla de instrucciones para escribir textos en chino a partir de otros textos, también en ese idioma. La dinámica del experimento es que el sujeto recibe un texto por la ventana de entrada, crea un nuevo texto siguiendo las instrucciones y lo entrega por la ventana de salida. Claramente, el sujeto manipula los símbolos sin entender nada.

Afuera del cuarto hay un hablante nativo de chino que recibe y entiende los textos, y le parecen producidos por hablantes nativos del chino. Los diálogos son arbitrarios, el observador se convierte en el entrevistador y el cuarto chino gana el juego de imitación. Este experimento muestra que pasar la prueba de Turing e, incluso, jugar exitosamente el juego de la viva voce, no es suficiente para pensar, entender, sentir y ser consciente.

El argumento del cuarto chino parece ser definitivo, pero hay quienes no lo aceptan. La respuesta principal es que, aunque el sujeto dentro del cuarto no es consciente (no conoce ni entiende el idioma chino), el sistema compuesto por el cuarto, con el sujeto y sus entradas y salidas como un todo, sí lo es. En ese sentido, el robot Golem-III y el programa ChatGPT se deberían considerar como entes conscientes, a pesar de que la computadora, que es determinista, no lo sea. Sin embargo, esta posición diluye la distinción entre los sistemas que son conscientes de los que no lo son, y tiene como consecuencia que cualquier órgano, dispositivo o sistema, natural o producto del ingenio humano que transforme una entrada en una de salida, sería consciente. Por ejemplo, el estómago, el corazón o el hígado; las plantas y todos los animales; los hongos y las bacterias; los sistemas físicos, como las estrellas y las galaxias, incluyendo al universo entero; o los termostatos, los coches, los radios y las computadoras, se tendrían que considerar como conscientes. Pero esto es absurdo, por sentido común, además de que, si todo sistema es consciente, el concepto de conciencia se vacía y se vuelve retórico.

La prueba de Turing representa un nuevo capítulo en la historia del autómata que aspira a hacerse consciente y convertirse en ser humano; es el Prometeo, el Golem, el Frankenstein y el Pinocho. A final de cuentas, es la historia de cada ser humano, porque lo que nos es

dado es nuestra condición biológica-social-maquinal, llena de condicionamientos, preconcepciones y prejuicios, y ganamos nuestra humanidad en la medida en que creamos nuestra propia persona y nos apropiamos de nuestra conciencia; pero debemos asumir la incertidumbre y el costo de ser libres. La prueba de Turing está profundamente inscrita en el imaginario colectivo y los robots, como los juguetes, son objetos simbólicos en los que nos reflejamos.

“Entre los actos externos y el pensamiento no hay conexión esencial, me dijo; es posible que tu interlocutor no piense más que su reloj: ¿deberíamos aceptar como ser pensante al primer animal que aprendió a hablar? ¿Quién te dice que todos los hombres no son sino papagayos educados? (…) Esta comparación es ingeniosa, respondió; no es por el movimiento y los sonidos, sino por el hilo de las ideas, la consecuencia que vincula las proposiciones y la conexión de los razonamientos que hay que decidir si un ser piensa: si fuera un loro que contesta a todo, afirmaría, sin dudar, que es un ser pensante”.

Pensamientos Filosóficos, Denis Diderot (1746).

Una prueba operativa para determinar si una computadora es inteligente o no.

Los robots, como los juguetes, son objetos simbólicos en los que nos reflejamos.